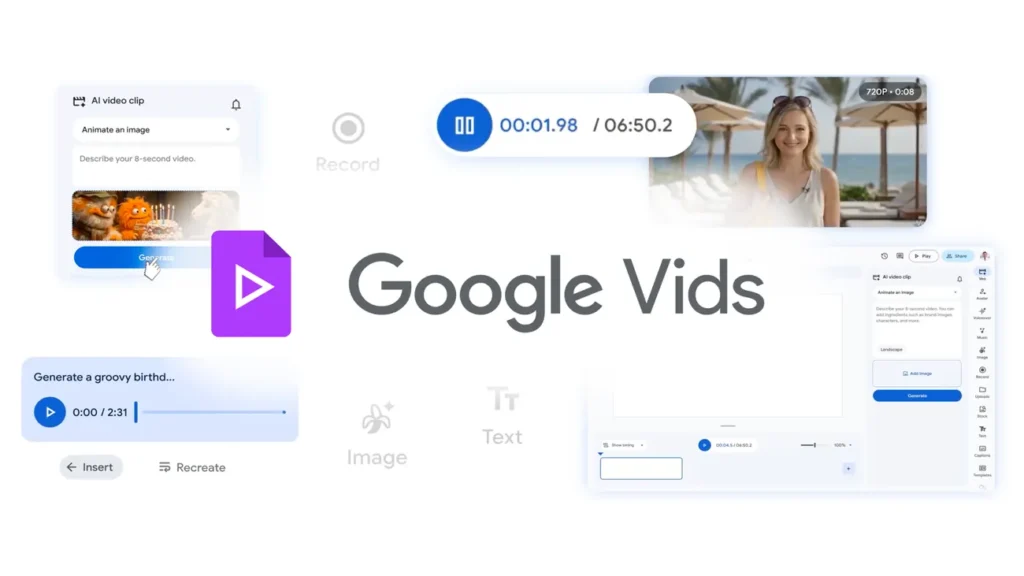

Google znacząco rozbudowuje swoje narzędzie Vids, wprowadzając najnowsze modele generatywne: Veo 3.1 i Lyria. Zaś gdy OpenAI robi krok do tyłu w kwestii generowania wideo, konkurent z Mountain View przyspiesza.

Wideo, które faktycznie wygląda jak wideo

Veo 3.1 to serce całej aktualizacji. Google wdrożyło już ten model w aplikacji Gemini pod koniec zeszłego roku i obiecało znaczną poprawę w realizme oraz spójności generowanych materiałów. Tym razem wideo generowane w Vids ciągle mają osiem sekund długości i rozdzielczość 720p, co nie jest niczym imponującym, ale dla szybkiego stworzenia treści do mediów społecznych wystarczy.

Co ważne: Google nie reklamuje Vids jako narzędzie dla filmowców (w przeciwieństwie do tego, jak pozycjonuje Veo). Zamiast tego mówi o tworzeniu animowanych plakatów na imprezy, reklam biznesowych czy wideo-kartek pozdrowień. Praktyczne, choć niezbyt ambitne zastosowania.

Limity zależą od portfela

Tu pojawia się haczyk. Darmowy dostęp to zaledwie 10 generacji wideo miesięcznie. Subskrypcja AI Pro to 50 filmów, a ekskluzywny plan AI Ultra (dostępny w wariantach personal i enterprise) daje 1000 generacji na miesiąc. Google wyraźnie chce zarobić na tych narzędziach.

Lyria komponuje muzykę za nas

Modele Lyria do tworzenia muzyki są teraz zintegrowane z Vids. Najnowsza wersja to skrót myślowy dla każdego, kto siedzi nad kreowaniem treści: nie trzeba już pisać tekstów piosenek. Wystarczy opisać klimat, jaki chcesz osiągnąć, a AI stworzy 30-sekundowy lub trzominutowy utwór. Nieśmiały to nie będzie, ale dla animowanej kartki urodzinowej to robi robotę.

Mówiąc wprost, Google Vids to wcale nie narzędzie dla artystów, a bardziej asystent dla każdego, kto chce szybko stworzyć treść. Czy to dobrze, czy źle? Zależy od perspektywy. Z jednej strony demokratyzacja tworzenia wideo: każdy może coś zrobić bez umiejętności montażu. Z drugiej strony: jaki jest sens, jeśli będziemy wszyscy tworzyli treści wyglądające podobnie, oparte na tych samych modelach? Tutaj pojawia się pytanie o oryginalność i artystyczną wartość. Ale wiem, że dla biznesu i szybkiej komunikacji to genialne rozwiązanie. Trzeba patrzeć pragmatycznie: to jest narzędzie, a jak się go użyje, to już zależy od człowieka. Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl

Awatary AI, które rzeczywiście wyglądają konsekwentnie

Spójność zawsze była problemem systemów generatywnych. Gdy generujesz wideo scena za sceną, bohater zmienia się jak szaleniec. Google znalazło na to rozwiązanie: zestaw gotowych awatarów AI, zarówno fotorealistycznych, jak i kreskówkowych. Te postacie zachowują tę samą mowę, wygląd (z opcjonalnymi zmianami w wyglądzie) od sceny do sceny i możesz im polecić, co mają powiedzieć lub zrobić. Mogą nawet wchodzić w interakcję z obiektami w generowanym wideo.

To rzeczywiście zmienia grę. Zamiast nagminnej zmiany twarzy bohatera, masz spójną postać, którą możesz instruować.

Nagrywanie bez opuszczania przeglądarki

Google chce ograniczyć tarcie w obsłudze. Nowe rozszerzenie Chrome pozwala nagrywać ekran lub kamerę bezpośrednio bez otwierania pełnej aplikacji Vids. Wszystkie narzędzia do nagrywania są dostępne, a wideo można wysłać do głównej strony Vids do dalszych edycji.

Filmy, które tworzysz w Vids (czy to generowane AI, czy nagrywane tradycyjnie) teraz łatwiej się udostępnia. Zamiast pobierania i następnie przesyłania na YouTube, Vids może publikować bezpośrednio na platformie streamingowej Google. Wideo eksportowane domyślnie są ustawione jako prywatne, więc masz kontrolę nad udostępnianiem.

Wszystko dostępne już dzisiaj

Nowe funkcje są już włączone w Vids. Biorąc pod uwagę tempo, w jakim Google wdraża swoje modele, raczej nie będziemy czekać na stopniowe rozwinięcie tych narzędzi. Wszystko powinno działać od razu.

Czy to wystarczy, aby konkurować z OpenAI w segmencie wideo? Pytanie otwarte. Ale Google pokazało, że nie bierze przerwy. Podczas gdy konkurencja wacha się, Google jedzieli naprzód.