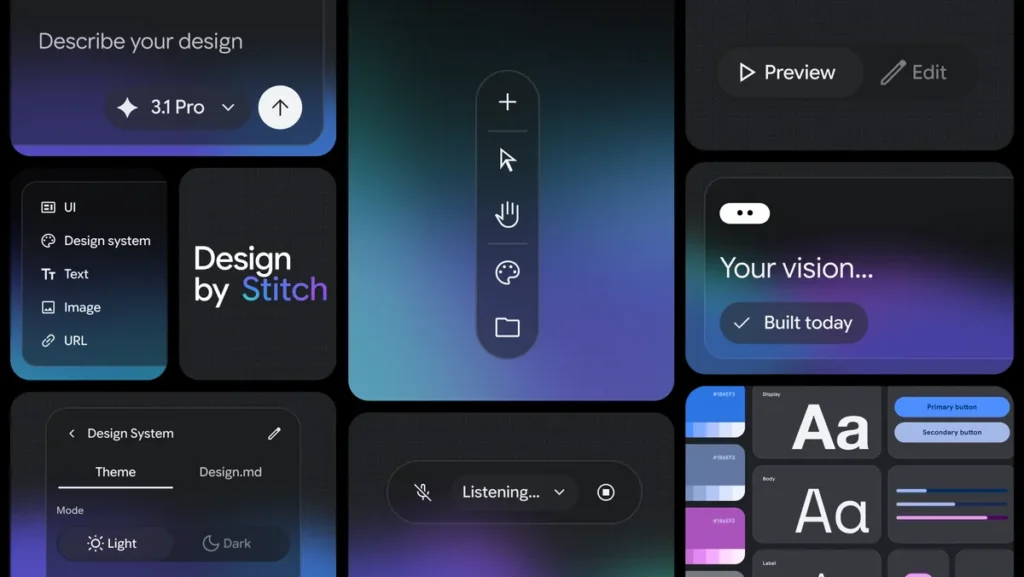

Google Labs ogłosiło wczoraj poważną ewolucję narzędzia Stitch – eksperymentalnego środowiska do projektowania interfejsów użytkownika przy pomocy AI. Stitch przestaje być prostym generatorem UI i staje się pełnoprawnym, AI-natywnym płótnem projektowym, w którym każdy – dosłownie każdy – może tworzyć wysokiej jakości projekty interfejsów, opisując je zwykłym językiem.

Vibe coding wchodzi w świat designu

Idea stojąca za tym krokiem nawiązuje do popularnego ostatnio pojęcia „vibe coding” – zamiast jednak pisać kod, użytkownik opisuje nastrój, cel biznesowy, a nawet to, co chce, żeby użytkownik końcowy poczuł, korzystając z aplikacji. Stitch ma z tych wskazówek wyciągnąć gotowy, interaktywny projekt UI.

Warto przypomnieć, że „vibe coding” to termin spopularyzowany przez Andreja Karpathy’ego – oznacza podejście, w którym programista opisuje, co chce osiągnąć, a AI generuje kod. Stitch przenosi tę filozofię w świat designu.

Czym wyróżnia się nowy Stitch

Google przeprojektowało interfejs narzędzia od podstaw. Oto co pojawia się w nowej wersji:

- Nieskończone, AI-natywne płótno (canvas), na którym można umieszczać obrazy, tekst i fragmenty kodu jako kontekst dla agenta

- Nowy agent projektowy, który śledzi historię całego projektu i rozumuje w kontekście jego ewolucji

- Agent Manager – zarządza pracą równoległą nad wieloma wariantami pomysłu jednocześnie

- DESIGN.md – plik w formacie markdown eksportujący lub importujący reguły systemu projektowego między różnymi narzędziami

- Możliwość wyciągnięcia systemu projektowego z dowolnego URL

Ta ostatnia funkcja może być szczególnie przydatna. Zamiast budować design system od zera, wystarczy podać adres strony, której styl chcemy odwzorować lub zainspirować się jej rozwiązaniami.

Projektuj głosem

Jedną z bardziej zaskakujących nowości jest możliwość projektowania głosem. Użytkownik może po prostu mówić do agenta – „pokaż mi trzy różne wersje menu” albo „zmień paletę kolorów na ciemniejszą” – a Stitch natychmiast reaguje. Agent może też prowadzić wywiad z projektantem, zadając pytania o cel strony, żeby lepiej dopasować projekt.

Stitch to ciekawy sygnał z rynku, bo Google mówi wprost: design staje się domeną nie tylko projektantów. Z jednej strony to demokratyzacja – founder może samodzielnie zwizualizować swój pomysł bez angażowania designera. Z drugiej pojawia się pytanie, co to oznacza dla branży UX/UI. Czy narzędzia AI zastąpią projektantów, czy raczej zmienią ich rolę – z twórców pikseli w architektów doświadczeń i kuratorów estetyki? Moim zdaniem to drugie, ale nie jest to pewne. I właśnie to „nie jest to pewne” powinno projektantów skłaniać do refleksji już dziś.

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl

Od projektu do kodu w jednym kroku

Stitch nie zatrzymuje się na etapie wizualizacji. Google dodało obsługę MCP (Model Context Protocol), SDK oraz eksport projektów do narzędzi deweloperskich, takich jak AI Studio i Antigravity. Dzięki temu designer może przekazać gotowy projekt bezpośrednio do środowiska programistycznego, a współpraca między designem a kodem staje się znacznie bardziej płynna.

Repozytorium Stitch Skills na GitHubie zebrało już 2,4 tysiąca gwiazdek – co sugeruje, że wokół narzędzia buduje się aktywna społeczność deweloperów.

Prototypy w kilka sekund

Stitch pozwala też na błyskawiczne tworzenie prototypów. Wystarczy połączyć ekrany przyciskiem „Stitch” i kliknąć „Play” – agent automatycznie generuje logiczne przejścia między widokami, odwzorowując ścieżkę użytkownika. Można w ten sposób przetestować flow aplikacji zanim napisze się choćby jedną linię kodu.

To podejście skraca dystans między pomysłem a weryfikacją założeń z dni do minut – i właśnie to Google podkreśla jako główny argument za Stitch. Narzędzie dostępne jest pod adresem stitch.withgoogle.com i wciąż funkcjonuje w ramach Google Labs, co oznacza, że jest to eksperyment – choć jak widać, coraz bardziej dojrzały.