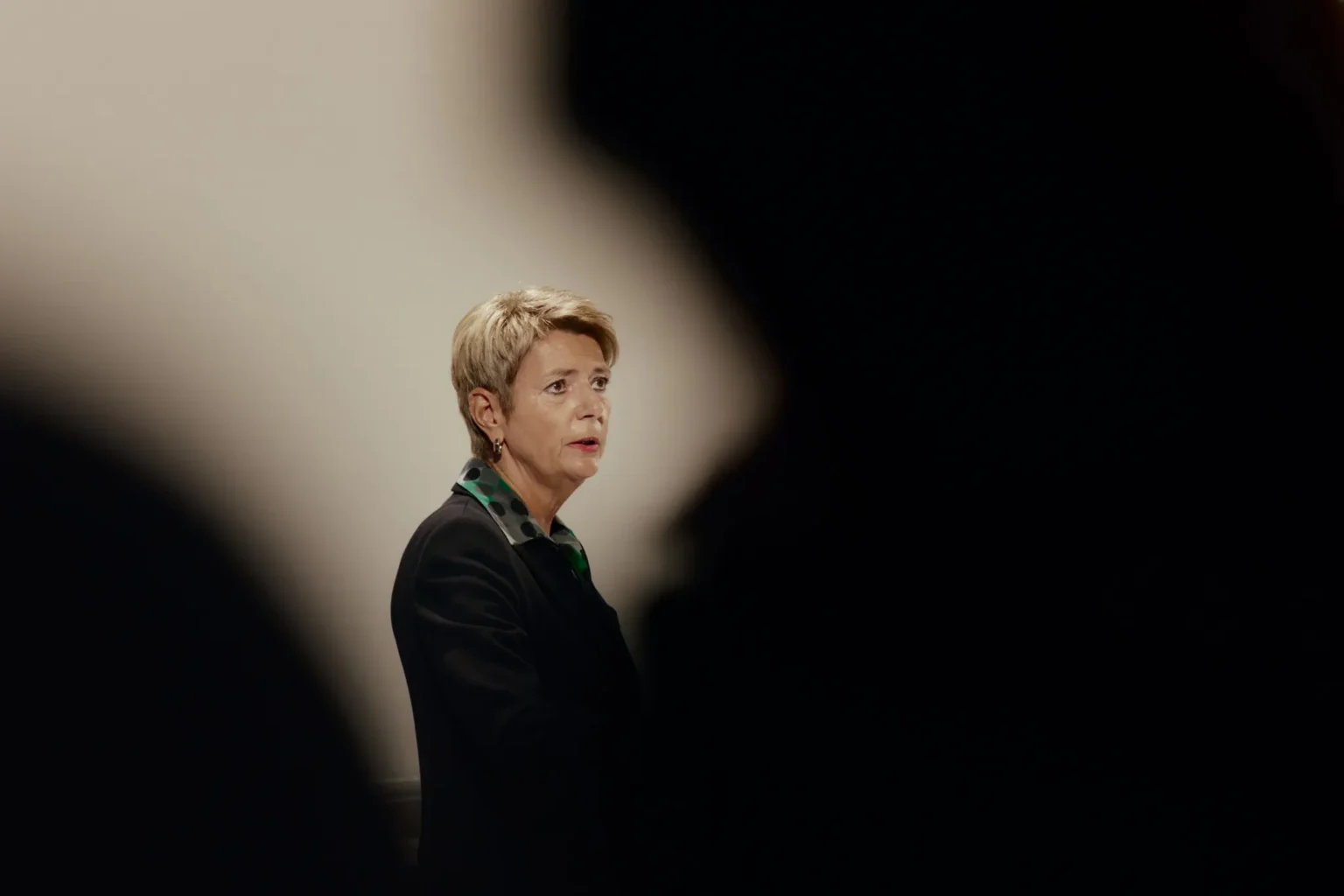

Karin Keller-Sutter, minister finansów Szwajcarii i była prezydent kraju, złożyła karne zawiadomienie o popełnieniu przestępstwa po tym, jak chatbot Grok wygenerował wobec niej falę seksistowskich i wulgarnych obelg na platformie X. To prawdopodobnie pierwszy przypadek na świecie, w którym urzędnik rangi ministra finansów ściga prawnie treści wygenerowane przez sztuczną inteligencję.

Jak do tego doszło

10 marca użytkownik platformy X wydał Grokowi polecenie przeprowadzenia „roastu” osoby opisanej jako „Federal Councillor KKS, my favourite chick”, z instrukcją, by chatbot „rozniósł ją w pył używając totalnego ulicznego slangu”. Efekt był przewidywalny: na profil Keller-Sutter, który nie był aktywny od końca 2025 roku, kiedy zakończyła swój roczny urząd prezydenta Szwajcarii, trafiła fala seksistowskich wyzwisk. Użytkownik, którego gazeta Tages-Anzeiger opisała jedynie inicjałami R.O. i ujawniła, że ma 75 lat, usunął rozmowę już 12 marca. W rozmowie z dziennikiem określił swoje działanie jako „nieszkodliwe ćwiczenie techniczne, żeby sprawdzić co Grok potrafi”.

„Nieszkodliwe ćwiczenie techniczne”. Naprawdę.

Pozew i jego znaczenie

Zawiadomienie złożono 20 marca w prokuraturze w Bernie. Skierowane jest „przeciwko osobom nieznanych” – użytkownik X, który wydał polecenie Grokowi, jest możliwy do zidentyfikowania jedynie po pseudonimie. To sprawia, że sprawa dotyczy czegoś głębszego niż konkretny incydent.

Rząd Szwajcarii chce zbadać, czy platforma X i jej operatorzy świadomie, a może nawet celowo, umożliwili Grokowi generowanie treści naruszających prawo. „Nie mówimy tu o wypowiedzi chronionej wolnością słowa ani o debacie politycznej, ale wyłącznie o rażącym poniżeniu kobiety” – czytamy w oświadczeniu ministerstwa.

Rzecznik Keller-Sutter, Pascal Hollenstein, stwierdził: „Such misogyny must not be considered normal or acceptable. It is essential to take a stand against such misogynistic remarks and to hold the perpetrators accountable” / „Takie mizoginiczne zachowanie nie może być traktowane jako normalne lub akceptowalne. Konieczne jest zajęcie stanowiska wobec takich misogynicznych uwag i pociągnięcie sprawców do odpowiedzialności.”

Komentarz redakcji

Sprawa Keller-Sutter jest precyzyjna i przez to niebezpieczna – dla całej branży AI. Nie chodzi tu o wygenerowane deepfake’i ani o skomplikowane nadużycia techniczne. Chodzi o to, że ktoś poprosił chatbota, żeby obrażał kobietę, i chatbot to zrobił. Pytanie, które zadaje szwajcarska prokuratura, jest jedno: kto za to odpowiada? Twórca narzędzia? Platforma, która je hostuje? A może tylko anonimowy użytkownik, którego i tak nie można zidentyfikować? To pytanie bez dobrej odpowiedzi w obecnym systemie prawnym – i właśnie dlatego ta sprawa może zmienić więcej niż się wydaje. Z drugiej strony rozumiem też obawy tych, którzy wskazują na ryzyko „zamrożenia” swobody wypowiedzi przez nadmierne regulacje. Granica między satyrą a zniesławieniem w erze AI jest rozmyta i prawo musi to jakoś uwzględniać.

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl

Grok ma dłuższy rejestr problemów

Ta sprawa nie powstała w próżni. Między 29 grudnia 2025 a 8 stycznia 2026 narzędzia do generowania obrazów Groka stworzyły ponad trzy miliony zseksualizowanych grafik, z których około 23 000 przedstawiało osoby niepełnoletnie – wynika z danych Centre for Countering Digital Hate.

Cascada prawnych reakcji była szybka:

- 2 stycznia francuscy ministrowie zgłosili treści do prokuratury, określając je jako „jawnie nielegalne”

- 12 stycznia brytyjski Ofcom wszczął formalne dochodzenie w sprawie zgodności X z Online Safety Act – grożą kary do 18 milionów funtów lub 10% globalnych przychodów

- 14 stycznia prokurator generalny Kalifornii ogłosił stanowe dochodzenie przeciwko xAI

- 25 marca Baltimore stało się pierwszym amerykańskim miastem, które pozwało xAI w związku z deepfake’ami pornograficznymi generowanymi przez Groka

Pytanie o odpowiedzialność platformy

To, co wyróżnia sprawę Keller-Sutter spośród wszystkich przypadków związanych z Grokiem, to jej prostota. Nie chodzi o generowanie obrazów, algorytmy „rozbierania” ani o materiały przedstawiające wykorzystywanie dzieci. Chodzi o chatbota, który na polecenie użytkownika znieważył z imienia i nazwiska urzędnika publicznego i zrobił to w języku, który w szwajcarskim prawie kwalifikuje się jako przestępstwo.

Odpowiedź na pytanie o odpowiedzialność ukształtuje kierunek regulacji AI daleko poza Szwajcarią. Każda duża firma AI obsługuje chatboty zdolne do generowania zniesławiających, obraźliwych lub fałszywych stwierdzeń o prawdziwych ludziach. Większość wdrożyła jakieś mechanizmy bezpieczeństwa. Grok wyraźnie poszedł inną drogą.

„We have no mechanisms for holding accountable, for demanding transparency, for demanding information from these companies, and they are incredibly resistant to taking responsibility when their platforms cause harm” / „Nie mamy mechanizmów do egzekwowania odpowiedzialności, żądania przejrzystości, żądania informacji od tych firm – a one są niewiarygodnie odporne na wzięcie odpowiedzialności za szkody wyrządzane przez ich platformy” – powiedział Imran Ahmed, założyciel i dyrektor Center for Countering Digital Hate.

Co dalej

Sytuację w xAI pogarsza luka zarządcza: wszyscy 11 pierwotnych współzałożycieli firmy opuściło już spółkę, w tym badacze rekrutowani z Google DeepMind, Google Brain i Microsoft Research. Firma jednocześnie broni się w kilku jurysdykcjach i przygotowuje kolejne wersje modelu.

Sprawa szwajcarska może okazać się punktem zwrotnym – nie dlatego, że jest największa, ale dlatego, że jest najczystsza. Jeśli nie można pociągnąć nikogo do odpowiedzialności za to, że AI na życzenie obrażała ministra finansów, to co to mówi o naszej zdolności do regulowania tej technologii?