Fabryki AI przestają być tylko pożeraczami prądu. NVIDIA razem z firmą Emerald AI i całą grupą gigantów energetycznych ogłosiła podczas konferencji CERAWeek nowe podejście, w którym centra obliczeniowe AI stają się elastycznym elementem infrastruktury sieciowej, a nie jej obciążeniem.

CERAWeek, czyli Davos branży energetycznej

CERAWeek to coroczna konferencja, na której spotykają się politycy, producenci energii, technolodzy i inwestorzy, żeby rozmawiać o tym, jak świat będzie się zasilał w przyszłości. W tym roku jednym z głównych tematów było rosnące zapotrzebowanie na energię ze strony infrastruktury AI.

NVIDIA i Emerald AI zaprezentowały tam wspólne rozwiązanie, które zmienia sposób myślenia o dużych centrach obliczeniowych. Zamiast traktować je jako stałe, pasywne obciążenie sieci, nowe podejście zakłada, że fabryki AI mogą działać jak inteligentne, elastyczne węzły energetyczne, które dynamicznie reagują na warunki w sieci.

Architektura, która łączy computing z zarządzaniem energią

Rozwiązanie zbudowano na bazie platformy NVIDIA Vera Rubin DSX AI Factory oraz systemu Conductor od Emerald AI. To połączenie akcelerowanych obliczeń, inteligentnego zarządzania mocą i sterowania w czasie rzeczywistym w jednej architekturze. Fabryka AI może produkować tokeny AI i jednocześnie reagować na aktualne zapotrzebowanie sieci, zmniejszając zużycie w szczytach i wspierając jej stabilność.

Do projektu dołączyły największe firmy energetyczne w USA: AES, Constellation, Invenergy, NextEra Energy, Nscale Energy & Power oraz Vistra. Planują one budować zdolności wytwórcze dostosowane do potrzeb fabryk AI opartych na tej architekturze, w tym projekty hybrydowe z energią wytwarzaną bezpośrednio przy centrum danych.

Tokeny na wat, czyli nowy wyścig wydajności

Jensen Huang od jakiegoś czasu powtarza, że fundamentem całej ery AI jest energia. W swoim słynnym modelu „five-layer AI cake” umieścił ją na samym dole warstw, jako fundament. I tak naprawdę cała ta inicjatywa jest odpowiedzią na jeden konkretny problem: wzrost energochłonności przy wzroście mocy obliczeniowej.

Kluczowym wskaźnikiem staje się dziś tokens per second per watt, czyli ile tokenów można wygenerować w przeliczeniu na każdy wat mocy. NVIDIA chwali się tutaj imponującym postępem, od procesora graficznego Kepler w 2012 roku do platformy Vera Rubin w 2026 roku liczba tokenów generowanych przy tym samym budżecie energetycznym wzrosła ponad milion razy.

Huang mówił o tym wprost w rozmowie z Lexem Fridmanem:

„Power is a concern, but it’s not the only concern. That’s the reason why we’re pushing so hard on extreme codesign, so that we can improve the tokens per second per watt orders of magnitude every single year.”

Robotyka, cyfrowe bliźniaki i szkolenia zawodowe

Przy okazji konferencji kilka firm z ekosystemu NVIDIA ogłosiło konkretne projekty:

- Maximo (spółka wyinkubowana przez AES) zakończyła instalację 100-megawatowej farmy słonecznej w lokalizacji Bellefield przy użyciu autonomicznych robotów opartych na NVIDIA Isaac Sim i Omniverse. To pierwsza realizacja tej skali wykonana w pełni przez roboty.

- TerraPower (wspólnie z SoftServe) zaprezentowała cyfrowego bliźniaka opartego na Omniverse, który ma skrócić czas projektowania zaawansowanych elektrowni jądrowych z lat do miesięcy.

- Adaptive Construction Solutions ogłosiło program praktyk zawodowych realizowany we współpracy z NVIDIA, który ma kształcić wykwalifikowanych pracowników do budowy i obsługi fabryk AI oraz infrastruktury energetycznej.

Komentarz redaktora

To jest ten moment, kiedy branża technologiczna przestaje udawać, że problem energetyczny rozwiąże się sam. Dobrze, że NVIDIA i partnerzy idą w kierunku integracji z sieciami energetycznymi, bo dotychczasowe podejście „budujemy, a prąd jakoś znajdziemy” zaczyna pękać pod własnym ciężarem.

Ale mam też otwarte pytania. Czy „elastyczna fabryka AI” to faktycznie stabilizator sieci, czy może kolejna narracja PR, która ma uśpić regulatorów i samorządy blokujące nowe centra danych ze względu na ich apetyt na energię? Ograniczenie poboru mocy w szczycie brzmi świetnie w prezentacji, ale diabeł tkwi w szczegółach kontraktów z operatorami sieci.

Jest też drugi wymiar, który warto obserwować. Wzrost efektywności o milion razy brzmi imponująco, ale historia pokazuje, że poprawa efektywności energetycznej niemal zawsze prowadzi do wzrostu popytu, a nie do jego ograniczenia. Efekt Jevonsa działa niezależnie od tego, jak dobrze brzmi slajd na konferencji.

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl

Schneider, GE Vernova i Vertiv domykają ekosystem

Po stronie infrastrukturalnej swoje ogłoszenia miały też firmy odpowiedzialne za fizyczną warstwę centrów danych:

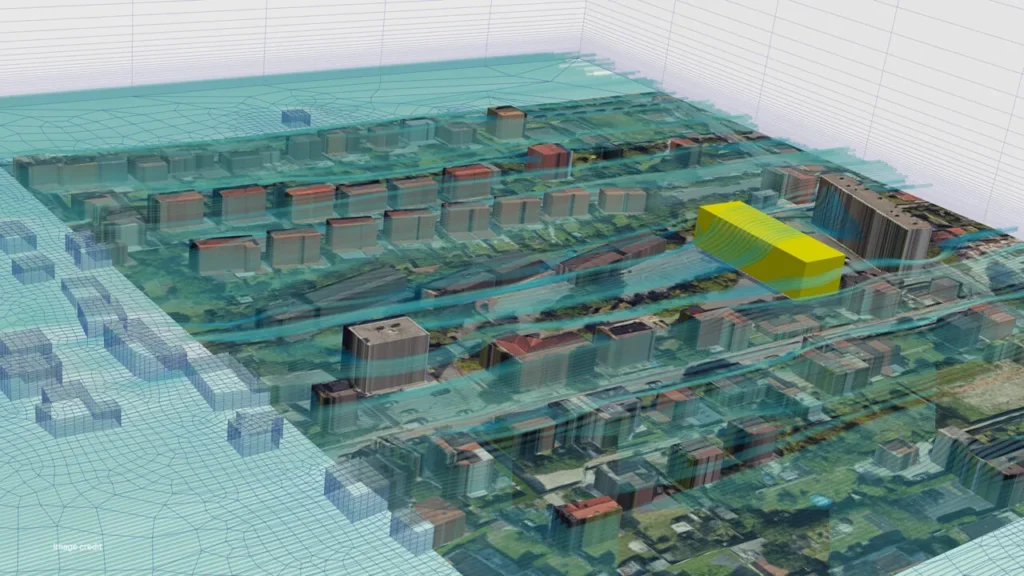

GE Vernova pokazała, jak cyfrowe bliźniaki zintegrowane z NVIDIA Omniverse DSX Blueprint pozwalają symulować zachowanie sieci energetycznej, stacji transformatorowych i obciążeń AI razem, jeszcze przed fizycznym wdrożeniem.

Schneider Electric zaprezentował zwalidowane projekty referencyjne dla platformy Vera Rubin oraz architekturę cyfrowego bliźniaka cyklu życia, opracowaną z AVEVA. Symulacje obejmują zasilanie, chłodzenie i sterowanie, co ma pomóc operatorom optymalizować wydajność jeszcze przed uruchomieniem infrastruktury.

Vertiv z kolei pokazał zunifikowaną, powtarzalną infrastrukturę fizyczną opartą na modułowych blokach zasilania i chłodzenia, gotową do integracji z architekturą Vera Rubin DSX.

Krok w dobrym kierunku, ale dopiero początek drogi

To, co prezentuje NVIDIA z partnerami, to przemyślana odpowiedź na jedno z największych wyzwań ery AI: jak budować infrastrukturę obliczeniową, która nie destabilizuje sieci energetycznej i nie pochłania zasobów szybciej, niż można je wytworzyć. Zamiana fabryk AI w elastyczne aktywa sieci to koncepcja, której branża potrzebuje. Teraz pytanie, czy znajdzie drogę z sali konferencyjnej do linii wysokiego napięcia.