Google po cichu usunęło funkcję wyszukiwania o nazwie „What People Suggest”, która agregowała porady zdrowotne od przypadkowych internautów. Firma twierdzi, że to część „szerszego uproszczenia” strony wyników wyszukiwania. Trudno jednak nie zauważyć, że decyzja zapada w wyjątkowo gorącym momencie.

Zdrowie według Reddita i X

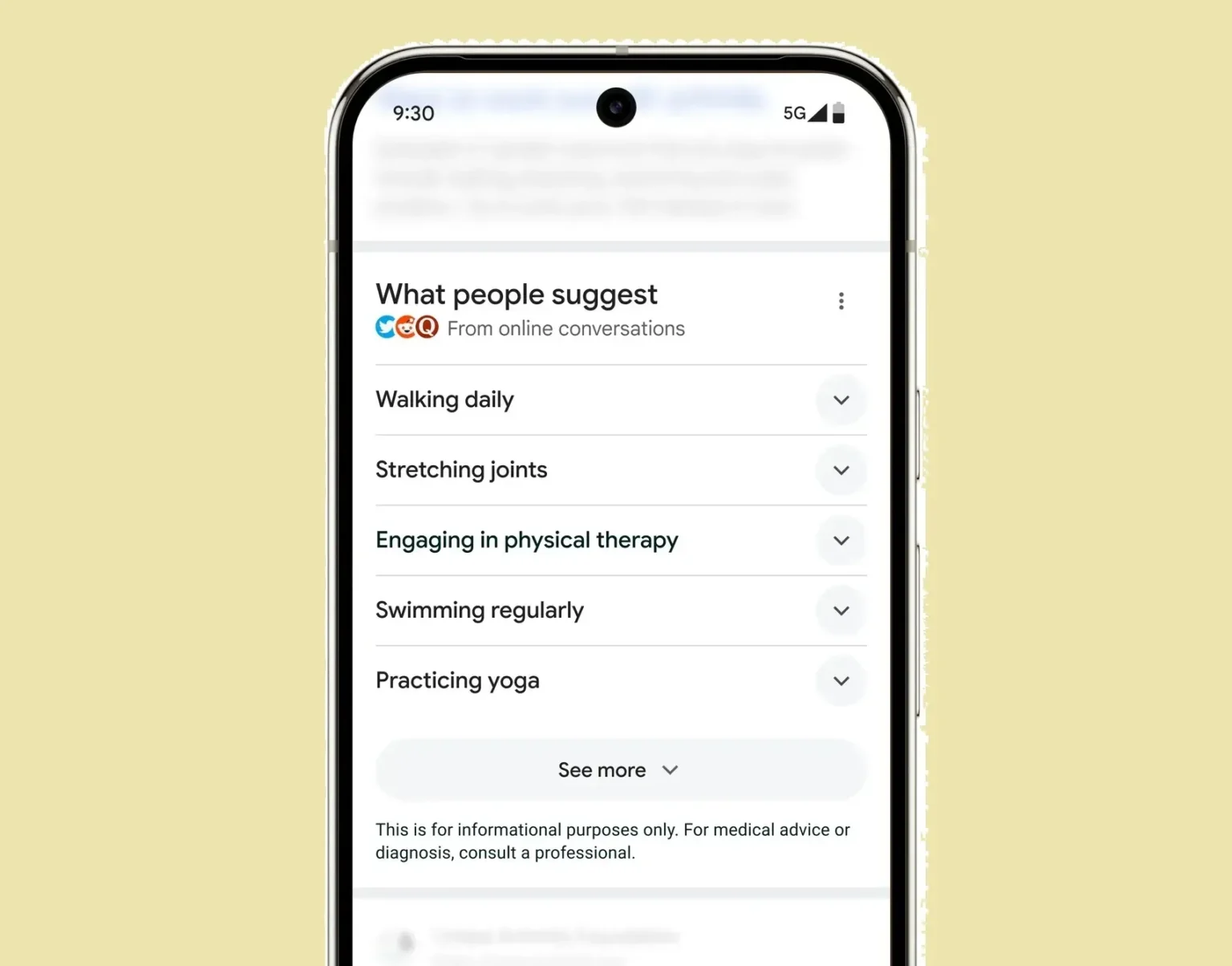

Funkcja „What People Suggest” korzystała ze sztucznej inteligencji do zbierania i prezentowania porad zdrowotnych z popularnych platform dyskusyjnych, takich jak Reddit, Quora czy X. W praktyce oznaczało to, że użytkownik pytający o objawy choroby czy metody leczenia mógł trafiać na odpowiedzi od anonimowych internautów, nieposiadających żadnych kwalifikacji medycznych, a wszystko to opakowane w znajomy, autorytatywny interfejs wyszukiwarki Google.

Kiedy funkcja była jeszcze aktywna, Google określało ją mianem „rewolucyjnego zastosowania AI, które ma transformować wyniki zdrowotne na całym świecie”. Karen DeSalvo, ówczesna dyrektorka ds. zdrowia w Google, pisała w poście na blogu firmowym: „While people come to search to find reliable medical information from experts, they also value hearing from others who have similar experiences.”

Można to rozumieć. Peer support ma realną wartość, a fora pacjentów potrafią być kopalnią praktycznej wiedzy. Problem pojawia się wtedy, gdy AI wyciąga z tych forów fragmenty i podaje je jako użyteczną odpowiedź na konkretne zapytanie zdrowotne.

Kłopotliwy kontekst

Google poinformowało, że usunięcie funkcji jest elementem „szerszego uproszczenia” strony wyszukiwania i nie ma związku z obawami dotyczącymi jakości ani bezpieczeństwa. Rzecznik prasowy firmy stwierdził wprost: „It had nothing to do with the quality or safety of the feature.”

To oficjalna wersja. Nieoficjalny kontekst jest jednak trudny do zignorowania.

W styczniu 2026 roku dochodzenie przeprowadzone przez „The Guardian” ujawniło, że AI Overviews w Google podawały mylące informacje w odpowiedzi na niektóre zapytania zdrowotne. Przykładem był zakres norm dla badań wątroby, które nie uwzględniały czynników takich jak płeć, wiek czy narodowość, przez co użytkownicy mogli błędnie ocenić swoje wyniki jako prawidłowe. Po tym śledztwie Google ograniczyło wyświetlanie AI Overviews dla kilku kategorii zapytań medycznych.

Rozumiem logikę, która stała za „What People Suggest”. Ludzie naprawdę szukają w internecie doświadczeń innych pacjentów i często jest to wartościowe uzupełnienie wiedzy medycznej. Problem polega na tym, że interfejs Google nadaje tym treściom powagę, której nie mają. Kiedy wyszukiwarka zwraca wynik w wyraźnie wyodrębnionym boxie, większość użytkowników traktuje go jak zweryfikowaną informację. Psychologicznie to ogromna różnica względem samodzielnego przeszukiwania Reddita. Pytanie, które Google powinno sobie zadać, brzmi: czy da się zbudować taki system z prawdziwymi zabezpieczeniami, czy po prostu nie da się tego zrobić odpowiedzialnie w wyszukiwarce masowego zasięgu?

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl

Ryzyko autorytetu i skala problemu

To jest sedno problemu. Badanie przeprowadzone przez Columbia’s Tow Center for Digital Journalism wykazało, że chatbot Gemini udzielał błędnych odpowiedzi na podstawowe pytania w aż 60 procentach przypadków. A to mowa o modelu językowym Google, nie o losowych internautach.

Połączenie obu elementów, czyli agregowania treści od amatorów przez model, który sam w sobie ma problemy z rzetelnością, to przepis na katastrofę w obszarze zdrowia. Lekarze od lat ostrzegają przed zjawiskiem „authority bias” w wyszukiwarce: gdy wynik pojawia się w wyróżnionym formacie, użytkownik odbiera go jako wiarygodny, nawet jeśli pochodzi z anonimowego komentarza sprzed pięciu lat.

Co dalej z AI i zdrowiem?

Wycofanie „What People Suggest” nie rozwiązuje szerszego pytania o to, jak duże platformy powinny obsługiwać zapytania medyczne. Google samo wpada w tę pułapkę wielokrotnie:

- AI Overviews z błędnymi zakresami norm laboratoryjnych

- Porady zdrowotne agregowane z nieweryfikowanych źródeł

- Presja na rozwijanie nowych funkcji zdrowotnych, bo to atrakcyjny rynek

Firma organizuje w tym tygodniu wydarzenie „The Check Up”, poświęcone badaniom nad AI w medycynie. To, czy Google odniesie się na nim do ostatnich wycofań funkcji zdrowotnych, powie dużo o tym, jak poważnie traktuje ryzyko w tej dziedzinie.

Regulatorzy w UE i Stanach Zjednoczonych przyglądają się tym dobrowolnym wycofaniom uważnie, testując, czy branża sama jest w stanie się uregulować, zanim do gry wkroczą przepisy. Na razie Google wybiera defensywę. Pytanie, czy to chwilowy odwrót, czy sygnał trwałej zmiany podejścia do AI w obszarach wysokiego ryzyka.