Nowa analiza przeprowadzona przez The New York Times pokazuje, że asystent AI w wyszukiwarce Google odpowiada poprawnie w 9 na 10 przypadków. Problem w tym, że przy skali Google’a oznacza to dziesiątki milionów błędnych odpowiedzi dziennie.

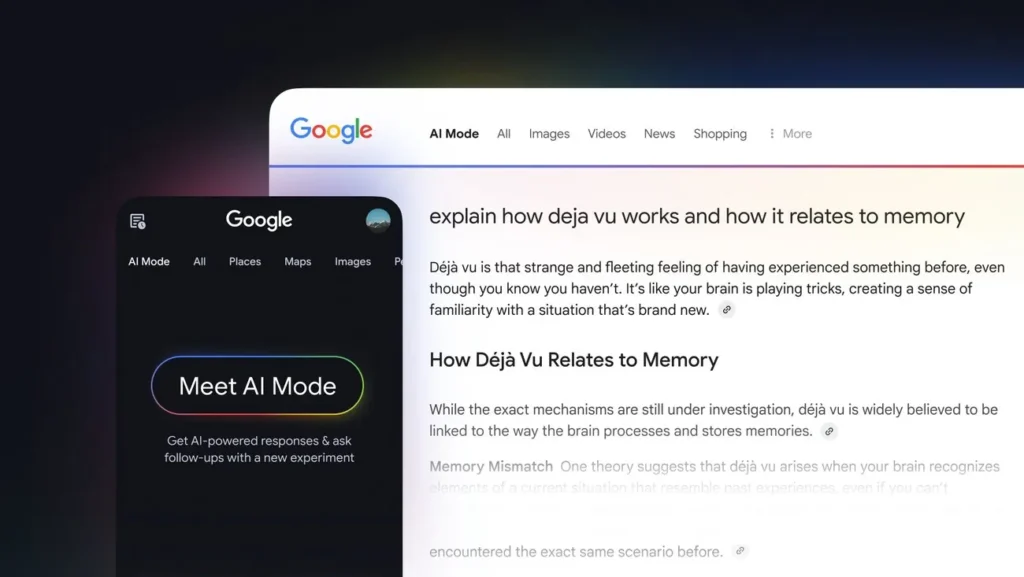

Kto dziś korzysta z wyszukiwarki Google, ten nie uniknie AI Overviews – funkcji napędzanej przez model Gemini, która wyświetla się na samej górze wyników wyszukiwania. Od premiery w 2024 roku funkcja ta zbiera cięgi za przypadkowe błędy i halucynacje. Poprawia się, owszem. Ale czy to wystarczy?

Startup przetestował Google’a jego własną bronią

The New York Times zlecił analizę startupowi Oumi, który sam zajmuje się rozwojem modeli AI. Firma wykorzystała benchmark SimpleQA – test stworzony przez OpenAI w 2024 roku, zawierający ponad 4000 pytań z weryfikowalnymi odpowiedziami.

Wyniki? Gdy Oumi przeprowadzało testy w zeszłym roku na Gemini 2.5, dokładność wynosiła 85%. Po aktualizacji do Gemini 3 wzrosła do 91%.

Brzmi nieźle. Do momentu, gdy uświadomimy sobie skalę.

Google przetwarza miliardy zapytań dziennie. Jeśli co dziesiąta odpowiedź AI jest błędna, mówimy o dziesiątkach milionów nieprawdziwych informacji serwowanych użytkownikom każdego dnia. Co godzinę.

Konkretne przykłady błędów

Raport NYT przytacza przypadki, w których AI Overviews spektakularnie się pomyliło:

- Na pytanie o datę przekształcenia domu Boba Marleya w muzeum, AI podało trzy źródła. Dwa w ogóle nie wspominały o dacie. Trzecie (Wikipedia) zawierało dwie sprzeczne daty – i Gemini wybrał tę błędną

- Zapytane o datę wprowadzenia Yo Yo Ma do Classical Music Hall of Fame, AI prawidłowo zacytowało stronę organizacji, a następnie stwierdziło, że… taka instytucja nie istnieje

Google nie jest zachwycone tym testem. Rzecznik firmy Ned Adriance stwierdził: „This study has serious holes. It doesn’t reflect what people are actually searching on Google” (To badanie ma poważne dziury. Nie odzwierciedla tego, czego ludzie faktycznie szukają w Google).

Firma twierdzi, że SimpleQA zawiera błędne informacje i woli własny test – SimpleQA Verified, oparty na mniejszym, dokładniej zweryfikowanym zestawie pytań.

Problem z benchmarkami

Ocenianie modeli AI to trochę sztuka, trochę nauka. Każda firma ma własne, preferowane metody prezentowania możliwości swoich modeli. A niedeterministyczna natura generatywnej AI sprawia, że weryfikacja czegokolwiek jest trudna.

Te same modele potrafią poprawnie odpowiedzieć na pytanie, a chwilę później – przy identycznym zapytaniu – kompletnie je zepsuć.

Jest jeszcze jeden haczyk. AI Overviews nie korzysta z jednego modelu. Google przyznało w rozmowie z Ars Technica, że używa „odpowiedniego modelu” do każdego zapytania. Teoretycznie najlepsze odpowiedzi dawałby Gemini 3.1 Pro, ale jest wolny i drogi. Dlatego w większości przypadków użytkownicy dostają szybsze modele z rodziny Gemini Flash.

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl:

Dziewięćdziesiąt procent dokładności brzmi imponująco – dopóki nie uświadomimy sobie, że mówimy o wyszukiwarce, z której korzystają miliardy ludzi. Przy takiej skali nawet 10% błędów to katastrofa informacyjna. Z drugiej strony, czy ktokolwiek oczekiwał, że AI będzie nieomylne? Problem leży gdzie indziej: w sposobie prezentacji. AI Overviews wyświetla się na samej górze, z autorytetem wyroczni. Użytkownik widzi podsumowanie i nie klika dalej. Nie sprawdza źródeł. A powinien – bo jak sam Google przypomina na dole każdego podsumowania: „AI can make mistakes, so double-check responses”. Pytanie brzmi: ilu użytkowników faktycznie to robi?

Google wie, że nie jest idealnie

Reakcja Google’a na raport NYT jest wymowna. W świecie faktograficznej dokładności AI, 9 na 10 to wcale nie jest zły wynik. Sama firma publikuje benchmarki dla nowych modeli, gdzie dokładność waha się między 60 a 80% – przy testach bez dostępu do wyszukiwania.

Zakotwiczenie AI w danych z internetu rzeczywiście poprawia dokładność w porównaniu z „gołym” modelem. Ale prawda wciąż jest gdzieś tam, w tych niebieskich linkach poniżej. AI Overviews zachęca użytkowników do akceptowania czasem niedokładnych podsumowań zamiast samodzielnego sprawdzania źródeł.

Google twierdzi, że wyniki NYT nie odzwierciedlają tego, co widzą prawdziwi użytkownicy. Trudno jednak zrozumieć, skąd firma miałaby to wiedzieć.

Błędy w AI Overviews widział chyba każdy z nas. Bo tak po prostu działają modele generatywne.