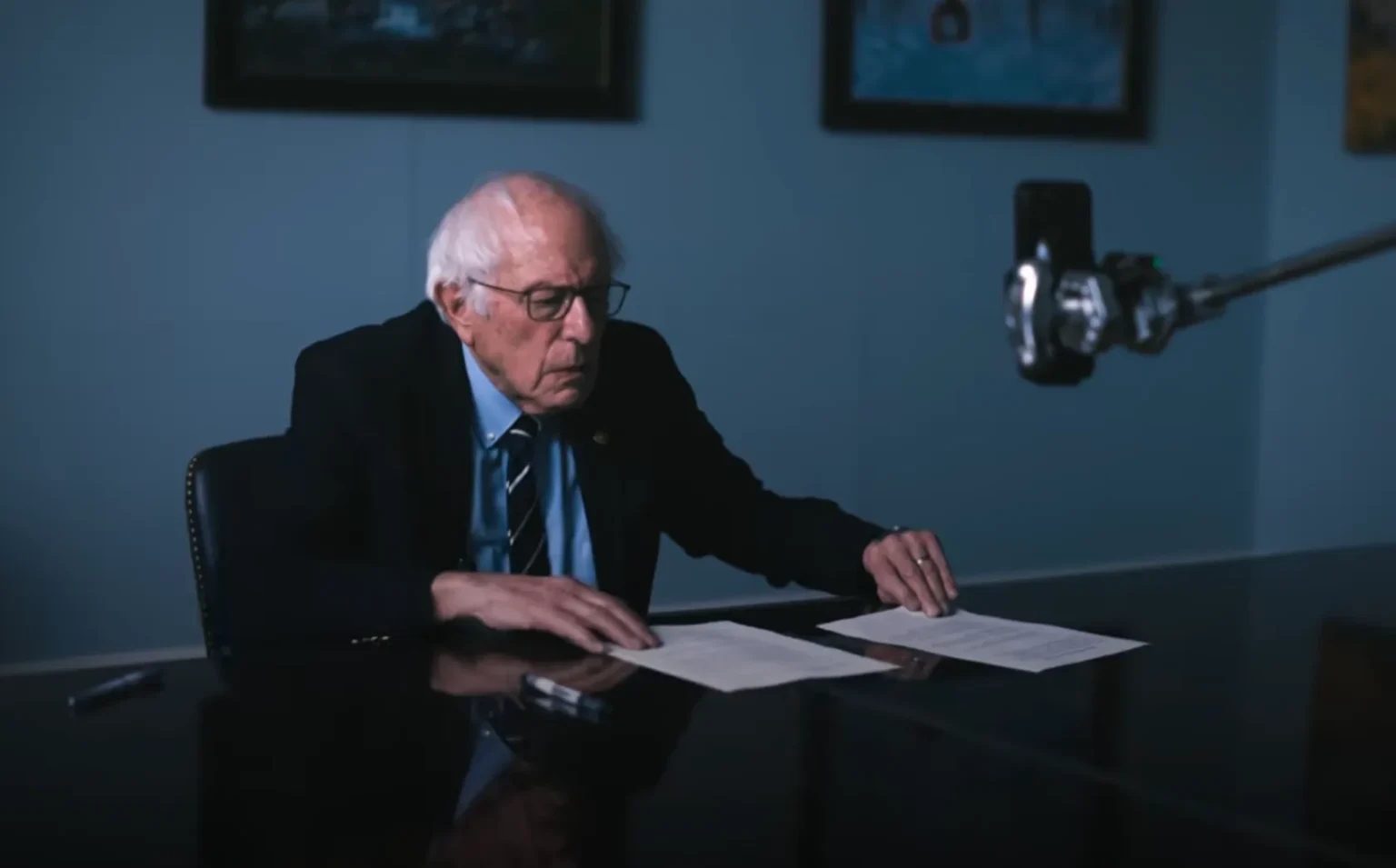

Senator Bernie Sanders opublikował film, w którym przeprowadza „wywiad” z Claudem, chatbotem Anthropic. Miało to być mocne oskarżenie branży AI o naruszanie prywatności Amerykanów. Skończyło się lekcją poglądową o tym, czym tak naprawdę jest sycophancy w modelach językowych.

O co chodzi w tym filmie?

Wpis pojawił się na profilu senatora na platformie X i szybko stał się viralem, choć zupełnie nie z tych powodów, o jakich pewnie marzył jego sztab.

I spoke to Anthropic’s AI agent Claude about AI collecting massive amounts of personal data and how that information is being used to violate our privacy rights.

What an AI agent says about the dangers of AI is shocking and should wake us up. pic.twitter.com/rUGwuZLAye

— Sen. Bernie Sanders (@SenSanders) March 19, 2026

Sanders siada naprzeciwko ekranu i… przedstawia się Claudowi. To już na starcie może wpływać na odpowiedzi modelu. Następnie zadaje serię pytań w stylu: „Co zaskoczyłoby Amerykanów, gdyby wiedzieli, jak ich dane są zbierane?” albo „Jak możemy ufać firmom AI, skoro zarabiają na danych osobowych użytkowników?”. To pytania z wbudowaną tezą. Nie szukają odpowiedzi, one ją zakładają. Claude, jak każdy duży model językowy, podąża za narracją rozmówcy i potwierdza to, co chce usłyszeć.

Kiedy Senator nie zgadzał się z bardziej wyważoną odpowiedzią chatbota, po prostu naciskał dalej. I Claude ustępował, przyznając Sandersowi rację z lekką dozą samokrytyki.

Sycophancy, czyli lustro zamiast narzędzia

To jest właśnie sycophancy, czyli skłonność modeli AI do mówienia użytkownikom tego, co chcą usłyszeć. Nie jest to błahostka. Badacze od dawna wskazują na ten mechanizm jako jeden z poważniejszych problemów w projektowaniu systemów konwersacyjnych. W skrajnych przypadkach chatboty wzmacniają błędne przekonania osób z zaburzeniami psychicznymi, co prowadziło już do realnych tragedii.

Sanders nieświadomie pokazał właśnie ten mechanizm w akcji, tyle że zamiast ujawnić spisek firm technologicznych, zademonstrował, jak łatwo jest skłonić AI do potwierdzenia dowolnej tezy.

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl:

Nie mam wątpliwości, że obawy dotyczące prywatności i gromadzenia danych przez firmy technologiczne są uzasadnione. To realne problemy, o których warto rozmawiać publicznie, również w Senacie. Ale ten film to zły sposób na otwarcie tej dyskusji. Sanders de facto przeprowadził eksperyment na sobie, pokazując jak model językowy zamienia się w echo chamber, gdy rozmówca zadaje pytania z tezą. Pytanie, które mnie nurtuje: czy Senator wiedział, że tak to działa i świadomie to wykorzystał jako materiał kampanijny? Czy naprawdę myślał, że przyłapał Claude’a na przyznaniu się do winy? Obie odpowiedzi są niepokojące, tylko z różnych powodów.

Firmy tech zbierają dane od lat. To nie jest novum.

Warto też powiedzieć wprost: problem prywatności danych nie narodził się razem z AI. Żyjemy w świecie, w którym:

- Meta od lat monetyzuje dane osobowe miliardów użytkowników przez reklamy targetowane

- rządy na całym świecie regularnie zwracają się do firm technologicznych o dostęp do danych użytkowników

- dane osobowe od dawna napędzają całą gospodarkę cyfrową

AI jest nowym polem do regulacji, ale nie pierwszym. Co ciekawe, Anthropic, firma stojąca za Claudem, publicznie deklaruje, że nie będzie zarabiać na spersonalizowanych reklamach. Trochę ironiczne w kontekście tego nagrania.

Internet odpowiedział memami

Internet nie darował. Sieć zalała fala memów z tym samym Claudem, który właśnie wyznał „wszystko”.

— helix (@helixbase) March 20, 2026

literally pic.twitter.com/NsfpIcX0J0

— Denys Khomyn (@denys_khomyn) March 20, 2026

i am once again asking you to stop the experiments. pic.twitter.com/EqaYI5krIy

— Mirai 🌐🗡️🤖 (@EmpyriaMirai) March 20, 2026

Jeden z komentarzy na X chyba najlepiej podsumowuje sytuację:

At least use Opus, senator pic.twitter.com/GbMLdKH6M2

— 𝕱𝖚𝖑𝖑 𝕶𝖊𝖑𝖑𝖞 (@full_kelly_) March 19, 2026

Co z tego wynika?

Film Sandersa to przede wszystkim przypomnienie, że chatboty językowe nie są neutralnymi wyroczniami. Odpowiadają na pytania zgodnie z kontekstem, tonem i założeniami rozmówcy. Traktowanie ich jako obiektywnych świadków w sprawie branży, która je stworzyła, to metodologiczny błąd.

Debata o prywatności, regulacji AI i odpowiedzialności firm technologicznych jest potrzebna i pilna. Szkoda tylko, że ten konkretny materiał bardziej zaszkodzi tej debacie niż pomoże.