Departament Obrony Stanów Zjednoczonych oficjalnie oznaczył Anthropic jako ryzyko dla łańcucha dostaw, ze skutkiem natychmiastowym. To bezprecedensowy krok, który może zmusić wykonawców rządowych do rezygnacji z modelu Claude w projektach wojskowych.

Decyzja Pentagonu to finał tygodniowego sporu, który wybuchł po tym, jak CEO Anthropic, Dario Amodei, odmówił spełnienia żądań administracji Trumpa. Sedno konfliktu? Pentagon chciał pełnej swobody w korzystaniu z Claude, włącznie z zastosowaniami w masowym nadzorze obywateli oraz w systemach broni autonomicznej. Anthropic powiedziało: nie.

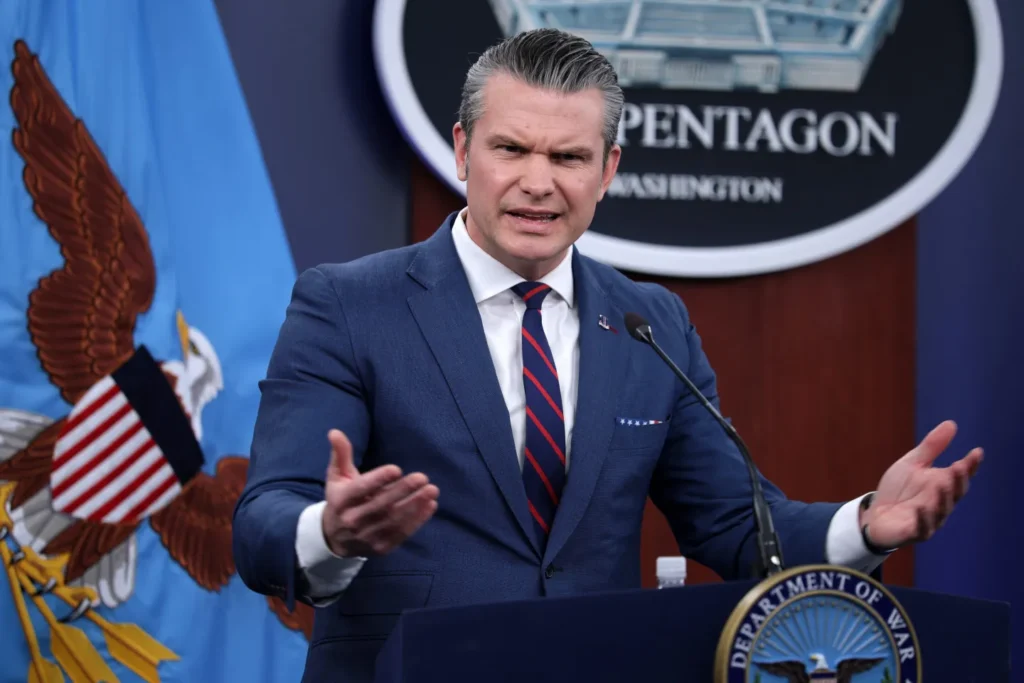

Komunikat Pentagonu jest krótki i dobitny: „this has been about one fundamental principle: the military being able to use technology for all lawful purposes. The military will not allow a vendor to insert itself into the chain of command by restricting the lawful use of a critical capability and put our warfighters at risk.”

Amodei ripostuje, że ograniczenia, których broni firma, dotyczą wyłącznie „high-level usage areas, and not operational decision-making” – i zapowiada zaskarżenie decyzji: „we do not believe this action is legally sound, and we see no choice but to challenge it in court.”

Prawo użyte niezgodnie z przeznaczeniem?

Tu zaczyna się najciekawsza część debaty. Przepisy federalne definiują ryzyko łańcucha dostaw jako zagrożenie ze strony obcego mocarstwa, które może sabotować lub szpiegować systemy. Innymi słowy: to narzędzie stworzone z myślą o chińskich czy rosyjskich firmach, nie o amerykańskich spółkach technologicznych działających w pełni transparentnie.

Senatorka Kirsten Gillibrand oceniła to jako „a dangerous misuse of a tool meant to address adversary-controlled technology” i dodała wprost: „This reckless action is shortsighted, self-destructive, and a gift to our adversaries.” List do kongresmenów podpisali też byli dyrektorzy CIA i dowódcy sił zbrojnych, w tym generał Michael Hayden. Ich wspólna ocena: „Applying this tool to penalize a U.S. firm for declining to remove safeguards against mass domestic surveillance and fully autonomous weapons is a category error with consequences that extend far beyond this dispute.”

Neil Chilson, były główny technolog FTC, nazwał decyzję „massive overreach that would hurt both the U.S. AI sector and the military’s ability to acquire the best technology.”

Komentarz Piotra Wolniewicza, Redaktora Naczelnego AIPORT.pl:

Z jednej strony można rozumieć frustrację Pentagonu. Wojsko chce narzędzi bez ograniczeń, które sami narzucili zewnętrzni dostawcy. To realne napięcie, nie wymysł. Z drugiej strony, użycie przepisów o „supply chain risk” – stworzonych po to, by bronić się przed Huawei czy technologią beholden to Beijing – przeciwko amerykańskiej firmie, która po prostu nie chce, żeby jej modele służyły masowej inwigilacji obywateli, to pojęciowy błąd o poważnych konsekwencjach. Pytanie, które wisi w powietrzu: czy firmy AI mają prawo stawiać etyczne granice wobec klientów rządowych? I kto ostatecznie decyduje o tym, co jest „lawful purpose”?

Wykonawcy odwracają się od Anthropic. Ale nie wszyscy

Lockheed Martin poinformował, że dostosuje się do wytycznych Departamentu Obrony i będzie szukać alternatywnych dostawców modeli językowych, dodając przy tym z rozbrajającą szczerością, że „nie jest uzależniony od żadnego pojedynczego dostawcy LLM.” Microsoft po analizie prawnej stwierdził natomiast, że może kontynuować współpracę z Anthropic – tyle że wyłącznie przy projektach niezwiązanych z obronnością.

Trump dał wojsku sześć miesięcy na wycofanie Claude z platform bezpieczeństwa narodowego. Amodei przyznał, że prowadził „productive conversations” z Pentagonem w ostatnich dniach – zarówno o możliwości dalszego korzystania z modelu, jak i o „smooth transition” w razie braku porozumienia. Priorytetem, jak podkreślił CEO, jest to, żeby żołnierze nie zostali „deprived of important tools in the middle of major combat operations.”

Paradoks: bojkot Pentagonu nakręcił konsumencki boom

Ironia sytuacji jest uderzająca. W tym samym tygodniu, gdy Anthropic traci kontrakty wojskowe, firma notuje bezprecedensowy wzrost liczby użytkowników. Ponad milion nowych rejestracji dziennie w tym tygodniu – popierając stanowisko firmy w sprawie nadzoru i broni autonomicznej, zwykli użytkownicy głosowali nogami. Claude wyprzedził ChatGPT i Gemini jako najpopularniejsza aplikacja AI w ponad 20 krajach w App Store.

Spór pogłębił też rywalizację Anthropic z OpenAI. Kilka godzin po tym, jak Pentagon ukarał Anthropic, OpenAI ogłosiło kontrakt na zastąpienie Claude w tajnych środowiskach wojskowych. Sam CEO OpenAI, Sam Altman, przyznał później, że nie powinien był się tak śpieszyć – bo deal „looked opportunistic and sloppy.” Amodei przeprosił natomiast za wewnętrzny komunikat do pracowników, w którym zaatakował OpenAI i sugerował, że Anthropic jest karane za brak „dictator-like praise” wobec Trumpa.

Co dalej?

Zakres decyzji Pentagonu pozostaje niejasny. Według Amodeia notyfikacja, którą firma otrzymała, sugeruje, że dotyczy ona wyłącznie bezpośredniego zastosowania Claude w kontraktach wojskowych – nie wszystkich produktów Anthropic. Firma zamierza to kwestionować w sądzie.

Kilka kluczowych faktów na koniec:

- Trump dał wojsku 6 miesięcy na wycofanie Claude z platform bezpieczeństwa narodowego

- Claude jest już głęboko osadzony w systemach militarnych i wywiadowczych

- Microsoft może kontynuować współpracę z Anthropic poza projektami DOD

- Lockheed Martin szuka alternatywnych dostawców LLM

- Ponad 1 milion nowych użytkowników dziennie dołączyło do Claude w tym tygodniu

Sprawa trafi do sądu. A stawką jest nie tylko przyszłość jednej firmy – ale precedens dotyczący tego, kto w demokratycznym państwie decyduje o granicach zastosowań sztucznej inteligencji w armii.