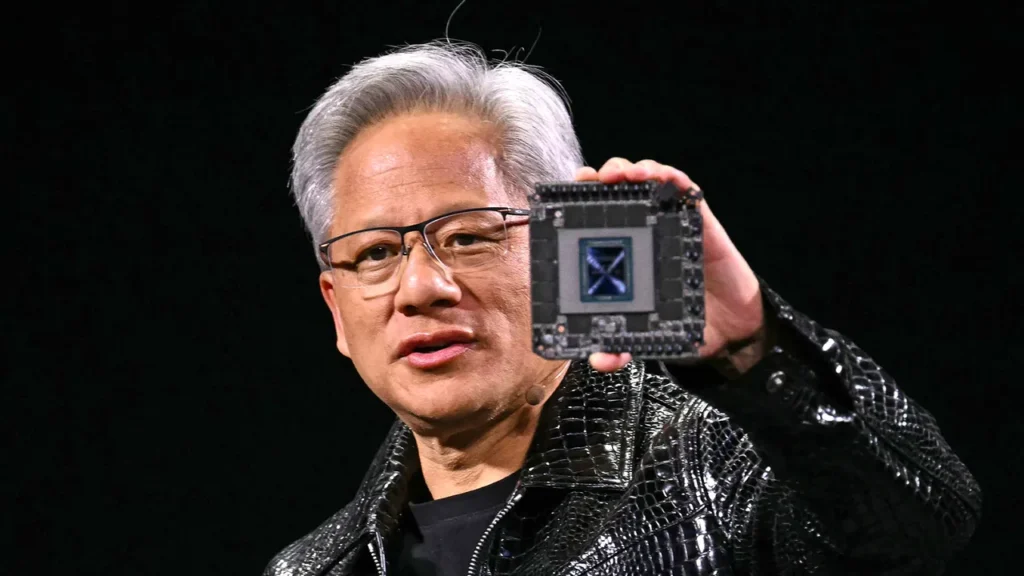

Nvidia szykuje się do kolejnego ruchu, który może zmienić reguły gry na rynku chipów AI. Według doniesień Wall Street Journal, firma planuje zaprezentować nową platformę obliczeniową skupioną wyłącznie na inference computing – i zrobi to już za kilka tygodni, podczas konferencji GTC w San Jose.

Przez lata Nvidia budowała swoją dominację na rynku trenowania modeli AI. GPU-y z rodziny H100 czy Blackwell stały się de facto standardem dla laboratoriów badawczych i największych firm technologicznych. Ale branża się zmienia. Coraz więcej firm pyta nie o to, jak szybko wytrenować model, tylko jak szybko on odpowiada użytkownikom. To właśnie inference – i tu Nvidia do tej pory miała wyraźną lukę.

Skąd ten pośpiech?

OpenAI od jakiegoś czasu nie kryje niezadowolenia z prędkości, z jaką sprzęt Nvidii obsługuje zapytania do ChatGPT, szczególnie przy skomplikowanych zadaniach jak generowanie kodu czy komunikacja między agentami AI. Firma potrzebuje nowego sprzętu, który docelowo pokryłby około 10% jej potrzeb inference’owych. Rozmawiała z kilkoma startupami – między innymi Cerebras i Groq. Zanim jednak doszło do jakiejkolwiek umowy, Nvidia weszła z przebiciem.

W grudniu ubiegłego roku, dosłownie w wigilię Bożego Narodzenia, chipmaker ogłosił umowę licencyjną z Groq opiewającą na 20 miliardów dolarów. To największa transakcja w historii firmy, bijąca na głowę przejęcie Mellanox za niespełna 7 miliardów w 2019 roku. W praktyce Nvidia przejęła całą intelektualną własność Groq oraz wciągnęła do swojego zespołu założyciela firmy, Jonathana Rossa, i większość kluczowych inżynierów. Groq formalnie istnieje nadal jako „niezależna spółka” – co brzmi nieco jak dyplomatyczna eufemizm.

Co tak naprawdę kupił Jensen Huang?

Groq zbudował coś fundamentalnie innego niż GPU. Ich Language Processing Unit (LPU) opiera się na pamięci SRAM umieszczonej bezpośrednio na chipie, zamiast korzystać z zewnętrznej pamięci HBM. Efekt? Prędkości inference rzędu 500-750 tokenów na sekundę, przy typowych ~100 tokenach na sekundę dla standardowych GPU. Układ działa deterministycznie – każde zapytanie jest obsługiwane w przewidywalnym czasie, bez „jitteru”, który potrafi dezorganizować systemy czasu rzeczywistego.

Właśnie ta cecha czyni LPU idealnym do zastosowań, gdzie liczy się nie tylko przepustowość, ale przede wszystkim czas odpowiedzi:

- systemy głosowe i asystenci działający w czasie rzeczywistym

- roboty przemysłowe i drony autonomiczne

- trading wysokich częstotliwości

- agenty AI komunikujące się między sobą

„Inference is disaggregating into prefill and decode.”

- Gavin Baker, inwestor Groq

Piotr Wolniewicz, Redaktor Naczelny AIPORT.pl:

Patrząc na ten ruch z boku, trudno nie przyznać, że Nvidia gra bardzo mądrze. Z jednej strony rozwiązuje realny problem techniczny – GPU-y rzeczywiście nie są optymalnym narzędziem do inference’u w każdym scenariuszu. Z drugiej, za 20 miliardów dolarów praktycznie eliminuje jednego z niewielu rywali zdolnych podważyć jej dominację w tym obszarze. OpenAI rozmawiało z Groq o dostawach chipów – i nagle tych rozmów nie ma. Sprawa zamknięta. To jest siła rynkowa w najczystszej postaci. Ale mam też pytania, na które na razie nie ma odpowiedzi: czy integracja architektury LPU z ekosystemem CUDA w ogóle jest możliwa bez stracenia tego, co czyni Groq wyjątkowym? Deterministyczny chip włożony w niedeterministyczne środowisko GPU może być jak zegarek szwajcarski przerobiony na części do Forda. Zobaczymy.

OpenAI w centrum układanki

Transakcja ma jeszcze jeden wymiar, który umyka przy powierzchownej lekturze. Nvidia inwestuje do 100 miliardów dolarów w OpenAI, obejmując udziały w zamian za dostęp do kapitału, który OpenAI przeznacza na… zakup chipów Nvidii. I teraz jeszcze blokuje OpenAI dostęp do alternatywnego dostawcy chipów inference. To zamknięte koło zależności, które powinno przykuć uwagę regulatorów bardziej niż niejedna formalna fuzja.

Nowy układ jest formułowany jako „niewyłączna umowa licencyjna” – co teoretycznie zostawia rynek otwarty dla innych. Praktycznie jednak 80% inżynierów Groq jest teraz w Nvidia. Ile warta jest licencja bez ludzi, którzy ją rozumieją?

Co dalej z rynkiem?

Paradoksalnie, przejęcie aktywów Groq przez Nvidia poprawiło sytuację pozostałych startupów chipowych. Cerebras, D-Matrix, SambaNova – wszyscy zyskali na wycenie, bo rynek udowodnił, że architektura dedykowana inference’owi ma wartość strategiczną. Cerebras szykuje się do IPO z wyceną w okolicach 20 miliardów dolarów. Kupuje je ktoś jeszcze, zanim zdąży wejść na giełdę?

Nowa platforma inference ma zostać oficjalnie zaprezentowana na konferencji GTC w San Jose w marcu. Nvidia nie potwierdziła szczegółów, OpenAI nie skomentowało. Ale akcje Nvidii wzrosły o 2,3% po pierwszych doniesieniach – rynek już podjął własną decyzję.

Era GPU jako jedynej odpowiedzi na potrzeby AI dobiegła końca. Nvidia wie o tym lepiej niż ktokolwiek – i właśnie dlatego zapłaciła 20 miliardów, żeby nikt inny nie wiedział tego wcześniej.